Die Digitalisierung beinhaltet moralische Dilemmata, die wir ohne sie normalerweise nicht hätten. Ein ethisches Urteil zu fällen ist ein Entscheidungsprozess, der das Sammeln und Auswerten von Informationen sowie das Abwägen und Abschätzen der Folgen alternativer Entscheidungen beinhaltet. Es ist sowohl ein rationaler als auch ein emotionaler Prozess, welcher vom persönlichen und sozialen Kontext und den Werten des Einzelnen abhängt. Es ist oft nicht so schwarz-weiß, wie es zum Beispiel bei einem der berühmtesten Experimente – dem selbstfahrenden Auto – der Fall ist.

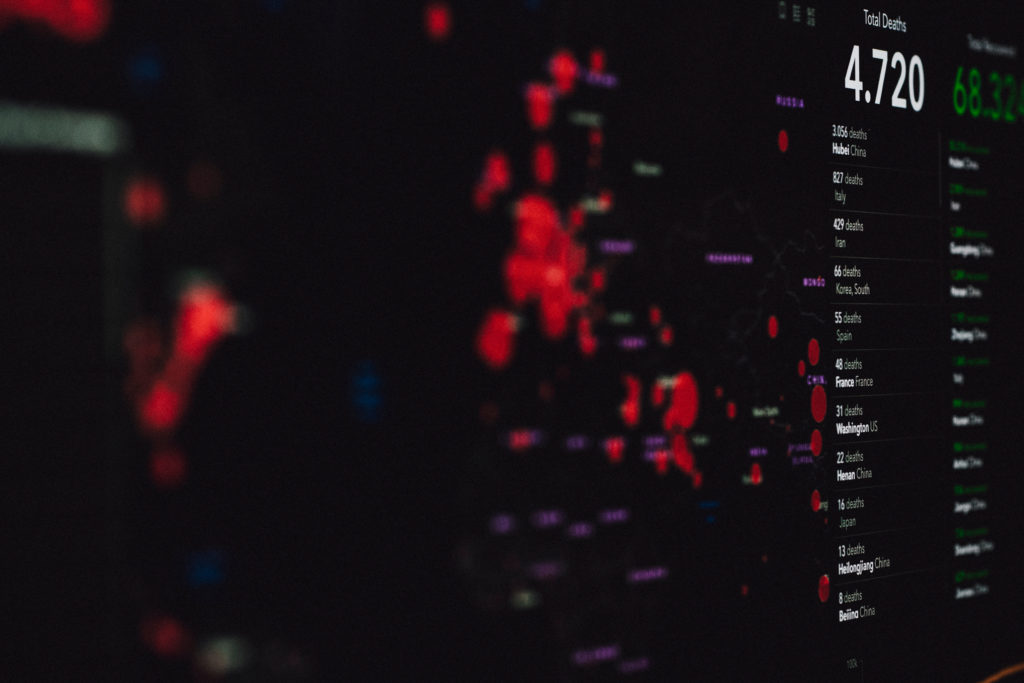

Manchmal sind es keine Entscheidungen um Leben und Tod, aber sie können dennoch weitreichende Folgen haben. Banken verwenden seit Jahren Bonitätsrechner, wenn sie über Kredite entscheiden. Öffentliche Einrichtungen setzen bei der Entscheidung über die Gewährung bestimmter Sozialleistungen zunehmend auf statistische Profilerstellung. Unternehmen verlassen sich mehr und mehr auf automatische Einstellungsinstrumente, die diskriminierend sein können. Ein jüngstes Beispiel ist die Debatte um den Corona-Immunitätspass – während einige gegen ihn argumentieren, um Stigmatisierung und Marginalisierung zu vermeiden, fördern andere ihn aus Gründen der öffentlichen Gesundheit. Deshalb wird der deutsche Ethikrat einbezogen. Einige Fragen haben teilweise Rechtssicherheit erhalten, während viele andere offen bleiben.

In diesem Blog zähle ich drei Aspekte auf, die wir im Auge behalten sollten, wenn wir uns mit ethischen Fragen in der digitalen Welt befassen.

Digitale Kluft

Vor kurzem habe ich über die digitale Kluft unter Studierenden aufgrund des Zugangs zu Technologie geschrieben. Eine solche vermeintlich einfache Voraussetzung kann darüber entscheiden, wer die Semesterprüfungen besteht und wer nicht. Es ist fast paradox, wenn man bedenkt, dass die Digitalisierung den Zugang zu Ressourcen auf globaler Ebene erweitert hat. Konnte Wissen früher nur über die Hochschulen oder die lokale Bibliothek erworben werden, so steht uns nun das gesamte Internet zur Verfügung. Wir können Online-Kurse besuchen (sogar kostenlos) und Forschungsdaten durch einen Klick erhalten. Und dies ist nur ein Beispiel aus dem Bildungskontext.

Wie bei anderen, traditionellen Ressourcen sind die Vorteile der Digitalisierung nicht gleichmäßig verteilt. Die Geschwindigkeit der digitalen Transformation macht es schwierig, ihre Vorteile zu verfolgen und ihre Nachteile anzugehen. Darüber hinaus wurde sie durch die außerordentliche Corona-Zeit zusätzlich beschleunigt. So kann der Zugang zu digitalen Ressourcen in Zukunft für Unternehmen zu einer Frage des wirtschaftlichen Überlebens, für politische Akteure zu einer Frage der politischen Prävalenz und für die Bürgerinnen und Bürger zu einer Frage der sozialen Teilhabe werden.

Das Erkennen solcher neuen Arten von Ungleichheiten wird zu einem moralischen Imperativ für (digitale) Gesellschaften. Das bringt uns zum nächsten Aspekt:

Digitale Kompetenz

Die Fähigkeit, Informationen zu sammeln und auszuwerten, Alternativen und deren Konsequenzen zu erwägen, steht im Mittelpunkt des ethischen Entscheidungsprozesses. Die digitale Welt hat uns einen beispiellosen Zugang zu Informationen ermöglicht, doch die Fähigkeit zu deren kritischer Betrachtung ist eine Kompetenzfrage. So wird die Datenkompetenz zu einer wichtigen Kompetenz in digitalen Gesellschaften.

- Benutze ich immer die gleiche Internet-Suchmaschine und klicke die ersten Treffer an? Ich glaube, viele von uns tun das.

- Benutze ich digitale Werkzeuge trotz ihrer Datenschutzbedenken? Weiß ich überhaupt, welche Folgen meine Einwilligung hat? Ich wette, viele von uns klicken die Datenschutzerklärung weg. Denn seien wir ehrlich, das Lesen dieser langen Erklärungen ist eine mühsame Aufgabe und etwas, das sowieso nur Juristen verstehen würden (?!)

- Leite ich Beiträge leicht weiter und „like“ sie? Kann ich die Interessen erkennen, die hinter einem Beitrag stehen? Handelt es sich um Tatsachen, Werbung oder Meinungen?

„Fake News“ sollen sich schneller verbreiten als „echte Nachrichten“. Zumindest wissen viele, was „fake News“ bedeuten (68 Prozent), was nicht über Algorithmen (43 Prozent) oder Bots (22 Prozent) gesagt werden kann.

Wie sollen wir in der Lage sein, Entscheidungen zu treffen, wenn wir nicht einmal wissen, wofür die Begriffe der neuen Technologien stehen und was ihre Auswirkungen sind? Und was ist mit den Fällen, in denen wir überhaupt keine Entscheidung treffen können, weil die Daten bereits für uns verarbeitet und ausgewertet wurden?

Künstliche Intelligenz in der Entscheidungsfindung

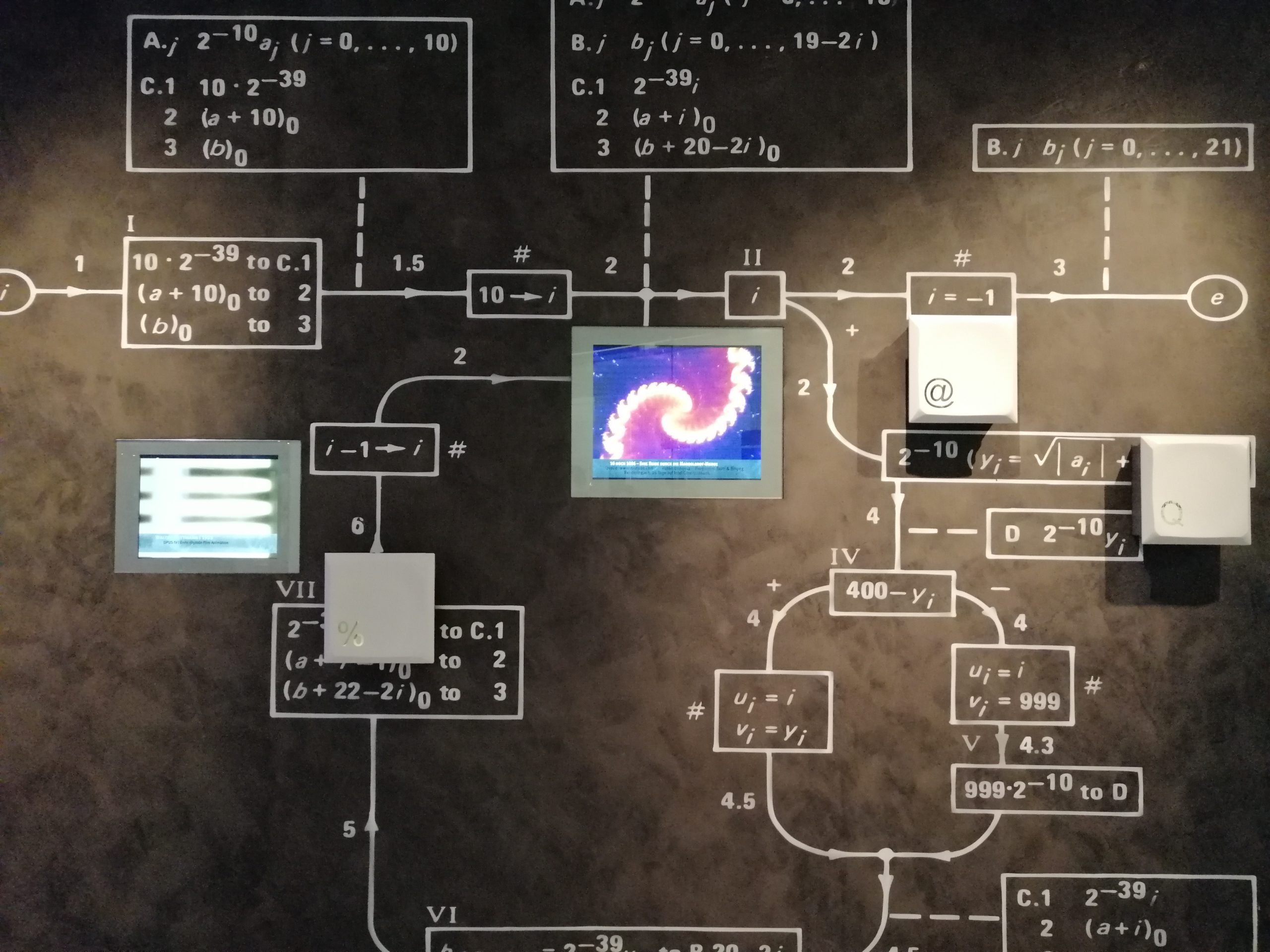

Das passiert, wenn künstliche Intelligenz eingesetzt wird. Auf der Grundlage von Daten und einer Reihe von Algorithmen versucht die Maschine, Entscheidungen zu treffen, wie es Menschen tun würden. Die Daten sind die Informationen, die der Maschine zur Verfügung stehen oder in sie eingespeist werden. Der Algorithmus ist der Prozess, der die Schritte enthält, um zu einer bestimmten Schlussfolgerung zu gelangen. Es gibt also mindestens zwei Probleme bei computergestützten Entscheidungen und jedes von ihnen könnte ethische Fragen enthalten:

- Datenbezogen: Wie sind die Daten erhoben worden? Gibt es Datenschutzbedenken? Ist der Datensatz neutral oder vermittelt er ein verzerrtes Bild von bestimmten Personengruppen (aufgrund ihres Online-Fußabdrucks oder aufgrund von geschlechtsspezifischen, ethnischen und anderen Merkmalen)?

- Algorithmus-bezogen: Wissen wir, wie die Maschine lernt? Welche Art von (statistischen) Modellen werden eingesetzt? Welche Art von Online-Verhalten wird dadurch gefördert?

Um diese Fragen zu beantworten, brauchen wir sowohl Transparenz als auch Expertenwissen – etwas, das meiner Ansicht nach nicht so bald erreicht werden kann. Dies sind nicht nur komplexe Prozesse, sondern werden oft als Betriebsgeheimnisse bezeichnet. Folglich wird die Gesellschaft Lösungen für solche ethische Konflikte, wie die Vertretung öffentlicher Interessen bei gleichzeitigem Schutz von Personen- und Firmendaten, finden müssen.

In dem Artikel „Automatisierte Entscheidungssysteme und der Kampf gegen COVID-19“ weist die gemeinnützige Organisation AlgorithmWatch auf Lösungen hin, die die digitale Kontaktverfolgung mit einem stärker auf die Wahrung von Rechten gerichteten Ansatz in Einklang bringen. AlgorithmWatch argumentiert weiter, dass der verstärkte Einsatz von Technologie bei der Erbringung von Dienstleistungen „katastrophale Folgen für die Bürger·innen haben [könnte], denen es an Zugang oder Mitteln mangelt, digitale Werkzeuge kritisch zu verstehen„.

Ich möchte hinzufügen, dass wir alle ein besseres Verständnis der Digitalisierung benötigen (worum es in meinem Blog geht), damit wir unsere Rechte wahrnehmen und dies von wirtschaftlichen und politischen Akteuren einfordern können.

P.S. Wie vielleicht bereits bekannt, mag ich Online-Kurse. Wenn Du mehr über künstliche Intelligenz erfahren möchtest, würde ich den kostenlosen Online-Kurs Elements of AI (auch auf Deutsch) empfehlen.

Foto oben: privat.

Leave a Reply